震憾!馬斯克一邊宣傳 AI 滅亡論,一邊卻為開(kāi)源界帶來(lái)了希望的火種,大模型 Grok-1 開(kāi)源了!

Grok-1 采用 Apache2.0 寬松協(xié)議,完全開(kāi)源可商用,Grok-1 的開(kāi)源模式打破了傳統(tǒng)的商業(yè)壁壘,讓更多人能夠參與到 AI 的發(fā)展中來(lái)。這無(wú)疑是開(kāi)源界的一場(chǎng)革命!這到底是怎樣的黑科技?讓我們一起來(lái)揭開(kāi)它神秘的面紗吧!

Grok-1生成提示詞后由Midjourney生成的3D神經(jīng)網(wǎng)絡(luò)圖

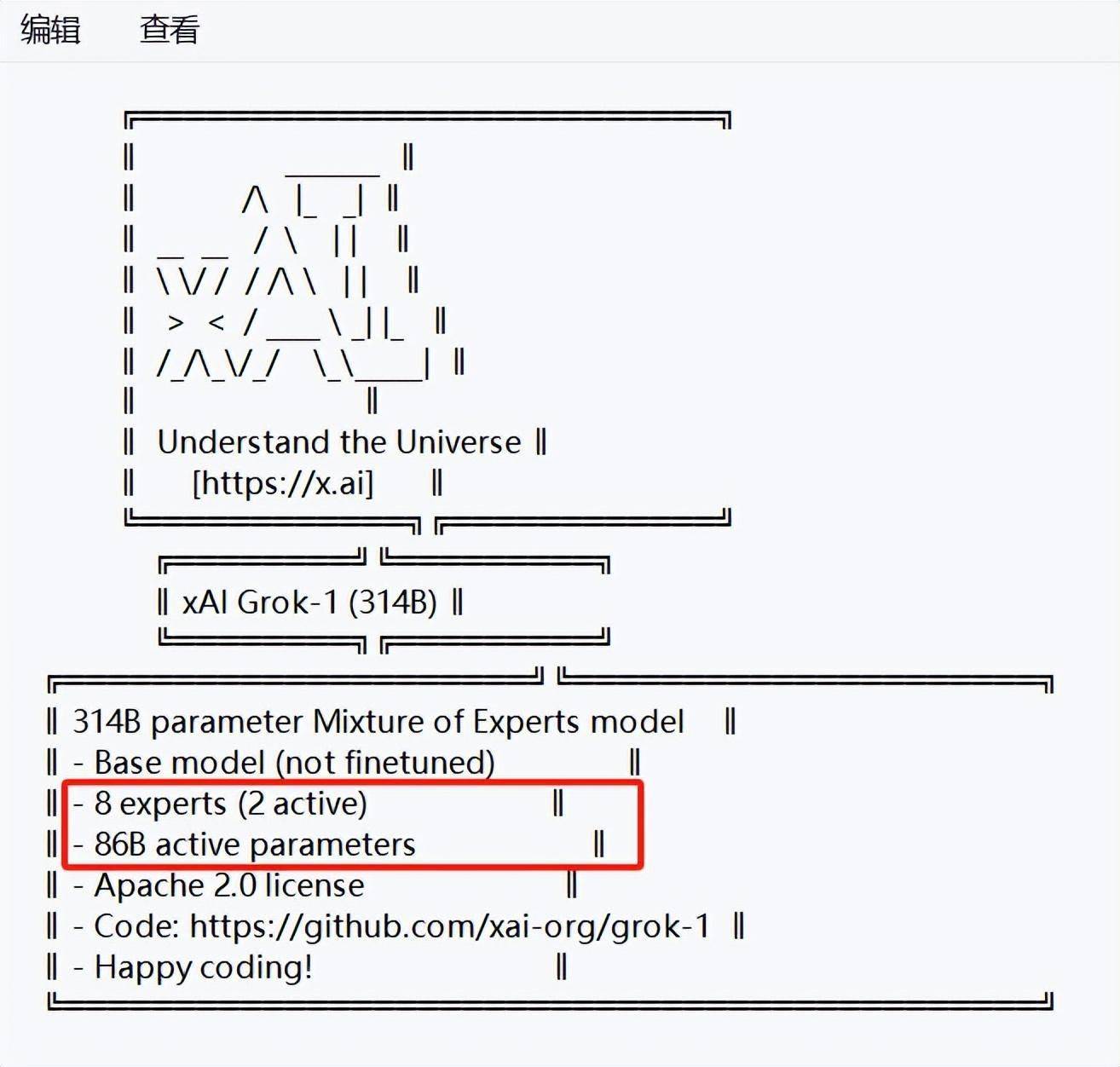

Grok-1 的參數(shù)的數(shù)量達(dá)到了驚人的 3140 億,如此龐大的參數(shù)數(shù)量意味著它能夠處理更加復(fù)雜的任務(wù),提供更加準(zhǔn)確和全面的結(jié)果。其中25%的參數(shù)能夠針對(duì)特定的數(shù)據(jù)單元(Token)激活,遠(yuǎn)遠(yuǎn)高于GPT3.5模型參數(shù)大小(一般認(rèn)為是1750億)。Grok-1的活躍參數(shù)高達(dá) 860 億,完整運(yùn)行它大約需要 5 臺(tái) H100。這種創(chuàng)新的架構(gòu)設(shè)計(jì)使得模型能夠更加高效地處理各種復(fù)雜任務(wù)。在各個(gè)測(cè)試集中呈現(xiàn)的效果 Grok-1要比GPT-3.5、70b 的LLAMA2和Inflection-1要好。開(kāi)源的預(yù)訓(xùn)練基礎(chǔ)模型雖然沒(méi)有經(jīng)過(guò)微調(diào),但這也為廣大開(kāi)發(fā)者提供了更多的可能性和發(fā)揮空間。

不僅如此,Grok-1 的知識(shí)截止日期為 2023 年 10 月,它擁有最新的知識(shí)和信息。而且,它的上下文窗口達(dá)到了 8912 個(gè) tokens,大約相當(dāng)于 4000 個(gè)漢字,能夠處理更長(zhǎng)更復(fù)雜的文本,為用戶提供更深入的理解和分析。

Grok-1 的 8 名混合專家架構(gòu)(MoE),每次輸入激活兩名專家的機(jī)制,就像是一場(chǎng)精準(zhǔn)的接力賽,讓模型的表現(xiàn)更加出色。

Grok-1 的發(fā)布無(wú)疑將推動(dòng)人工智能技術(shù)的發(fā)展,不僅為商業(yè)應(yīng)用打開(kāi)了大門(mén),更是對(duì)OpenAI 的有力回應(yīng)。這不僅是對(duì)OpenAI的挑戰(zhàn),也是對(duì)整個(gè)開(kāi)源界的推動(dòng)。

關(guān)注我們

關(guān)注我們